数据治理技术与数据处理服务的融合与演进

在数字化转型的浪潮中,数据已成为企业的核心资产。如何有效管理和利用这些数据,确保其质量、安全与价值,是每一个组织面临的重大课题。数据治理技术与数据处理服务,作为数据价值实现的两个关键支柱,正日益紧密地结合,共同构建起现代企业的数据能力基石。

一、 数据治理技术:构建秩序与信任的框架

数据治理并非单一的技术,而是一套综合性的技术体系与管理框架,旨在确保数据的可用性、一致性、完整性、安全性与合规性。其核心目标是建立对数据的有效管控,使其成为可信赖的战略资产。

关键技术领域包括:

1. 元数据管理: 这是数据治理的“地图”。通过采集、存储、分类和关联技术元数据(如表结构、ETL过程)和业务元数据(如业务术语、指标定义),实现对数据资产的全面盘点与血缘追踪,确保数据可发现、可理解。

2. 数据质量管理: 通过定义质量规则、进行数据剖析、监控、清洗和修复,持续提升数据的准确性、完整性和及时性。现代数据质量工具已能实现自动化检测与智能告警。

3. 主数据管理: 聚焦于核心业务实体(如客户、产品、供应商),通过创建和维护单一、准确、权威的数据源,消除数据冗余和冲突,保障关键数据在全企业范围内的一致性。

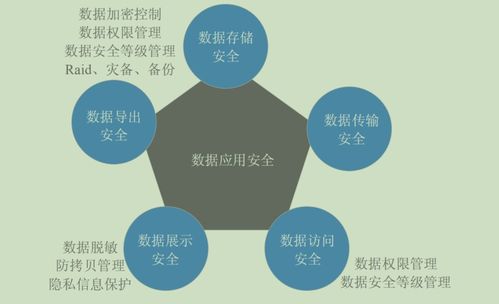

4. 数据安全与隐私保护: 涵盖数据分类分级、访问控制、加密、脱敏、匿名化以及审计日志等技术,确保数据在存储、传输和使用过程中的安全,并满足如GDPR、个人信息保护法等法规要求。

5. 数据目录与资产门户: 提供自助式数据搜索、理解和申请使用的平台,赋能业务用户和数据科学家,提升数据资产的利用效率。

二、 数据处理服务:驱动价值实现的引擎

数据处理服务侧重于对原始数据进行一系列操作,以提取、转换、加载并最终服务于分析、应用或决策。随着云计算和分布式计算的发展,数据处理服务正变得更加弹性、敏捷和智能化。

主要的服务形态与趋势:

1. 云原生数据服务: 以AWS、Azure、Google Cloud及国内云厂商为代表,提供从数据集成、存储(数据湖、数据仓库)、计算(批处理、流处理)到分析与AI的全栈托管服务。其核心优势在于弹性伸缩、按需付费和免运维。

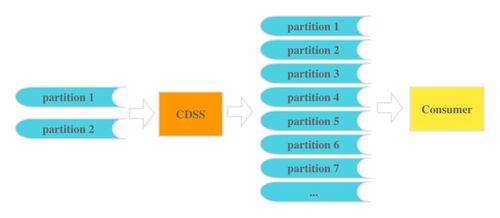

2. 实时/流式处理: 基于Apache Kafka、Flink、Spark Streaming等技术,实现对业务事件和数据的实时响应与分析,满足风控、监控、实时推荐等场景的毫秒级需求。

3. 数据融合与集成服务: 通过ETL/ELT工具(如Informatica、Talend、dbt)或数据管道服务,打破数据孤岛,将分散在多个源系统的数据高效、可靠地汇聚到统一的分析平台。

4. AI增强的数据处理: 机器学习被应用于自动化数据清洗、模式识别、异常检测,甚至自动生成数据转换代码,大幅降低人工成本并提升处理质量。

三、 融合共生:技术赋能服务,治理引领价值

数据治理技术与数据处理服务绝非孤立存在,而是呈现出深度融合的趋势:

- 治理嵌入流程: 数据处理服务的各个环节(如数据入湖、ETL开发)都需嵌入数据质量检查、元数据自动采集、安全策略执行等治理活动,实现“治理左移”,在数据生命周期的早期发现问题。

- 服务支撑治理: 强大的数据处理能力(如大规模数据剖析、血缘分析计算)是高效执行数据治理(如影响分析、合规审计)的技术基础。

- 一体化平台: 越来越多的平台(如Databricks、Snowflake、国内大数据平台)正在将治理能力(数据目录、安全、血缘)与核心的数据处理引擎(SQL、Spark)无缝集成,为用户提供“开箱即用”的、兼具治理与处理能力的统一体验。

- 数据Ops与治理自动化: 借鉴DevOps理念,通过自动化、可观测和协作的流程,将数据处理服务的开发、部署、运维与数据治理策略的执行紧密衔接,提升整体数据运营的敏捷性与可靠性。

四、 实践路径与未来展望

构建有效的数据治理与处理体系,应遵循“业务驱动、技术支撑、迭代演进”的原则:

- 从关键业务场景出发,识别高价值数据域,优先建立相应的治理规则和处理流水线。

- 选择适配的技术栈,平衡云服务与自建方案的利弊,优先考虑具备良好治理功能集成的数据处理平台。

- 建立协同的组织与流程,明确数据所有者、管理者和使用者的职责,通过工具平台固化协作流程。

- 持续度量与优化,建立数据质量、服务SLA、资产价值等关键指标体系,驱动治理与服务的持续改进。

随着数据编织、主动元数据、数据产品等理念的兴起,数据治理技术将进一步智能化、自动化,与数据处理服务的边界将更加模糊。最终目标是构建一个自服务、可信赖、高价值的数据环境,让数据能够像水电一样,安全、顺畅、高效地流向每一个需要它的业务终端,真正驱动企业的智能决策与创新增长。

如若转载,请注明出处:http://www.easicomedia.com/product/18.html

更新时间:2026-05-29 17:13:50